Ollama官网直达|国内安全下载,零门槛本地AI神器,新手必看

着急下载 Ollama 安装包的,直接提供下载地址: Ollama 安装包

Ollama 是一款由开源社区开发的本地AI模型运行工具,全程免费、开源,让普通用户能够在自己的电脑上轻松部署、运行各类 AI 大模型(如 Llama 3、ChatGLM、Qwen、Gemma4 ),无需复杂的代码配置、无需专业的技术知识,一键启动即可享受本地 AI ,Ollama 主打“零配置、易上手”,支持多类 AI 大模型部署、管理和交互,核心定位是“让普通人也能轻松使用本地 AI ”,区别于云端 AI 工具,无需联网即可运行。

Ollama 支持 Windows、Mac、Linux 三大主流系统,兼容性非常强 :

- Windows 系统适配 Windows 10/11( 32位、64 位均支持)。

- Mac 系统适配 MacOS 12 及以上版本,尤其对 Apple Silicon 芯片优化极佳,最新版本还能实现推理速度翻倍。

- Linux 系统适配 Ubuntu、CentOS 等主流发行版,同时还支持通过 Docker 容器运行,满足不同用户的设备需求。

Ollama 支持模型量化,占用电脑存储空间极少、下载速度极快,能显著降低显存需求。即使你没有顶级的显卡,也能在普通家用电脑上流畅运行数十亿参数级别的大模型。同时它还能充分利用 CPU 和 GPU 的算力,在同等配置下运行更大的模型,提升使用体验。

和同类型的软件相比,Ollama 的优势非常明显:

| 对比维度 | Ollama | LM Studio | GPT4All | llama.cpp |

|---|---|---|---|---|

| 核心定位 | 新手友好型本地AI运行工具,零配置、易上手,多模型适配,兼顾专业与易用 | 专业级本地AI工具,侧重模型自定义配置,适合专业开发者 | 轻量本地AI工具,侧重基础聊天功能,功能较为单一 | 专业级模型运行工具,侧重模型优化,操作复杂 |

| 操作难度 | ⭐⭐⭐⭐⭐(零门槛,一键操作,新手秒上手,无需代码) | ⭐⭐⭐(需手动配置参数,新手上手难) | ⭐⭐⭐⭐(操作简单,但功能有限) | ⭐⭐(需编写命令行,新手几乎无法上手) |

| 模型支持 | ⭐⭐⭐⭐⭐(支持Llama 3、ChatGLM等上百款主流模型,更新及时) | ⭐⭐⭐⭐(支持部分主流模型,自定义模型复杂) | ⭐⭐⭐(支持模型较少,更新不及时) | ⭐⭐⭐⭐(支持模型多,但配置复杂) |

| 收费情况 | 完全免费、开源,无任何限制,个人/商业均可使用 | 免费试用,付费解锁高级功能 | 免费使用,部分模型需付费下载 | 免费开源,但需手动编译,门槛高 |

| 广告/捆绑 | 无广告、无捆绑,干净纯粹,下载即用 | 免费版有广告,无捆绑 | 无广告,部分渠道有捆绑 | 无广告,但操作复杂,需手动配置 |

| 跨平台支持 | ⭐⭐⭐⭐⭐(Windows、Mac、Linux全支持,适配性强) | ⭐⭐⭐(支持Windows、Mac,Linux适配较差) | ⭐⭐⭐(支持Windows、Mac,Linux适配一般) | ⭐⭐⭐⭐(支持多系统,但需手动编译) |

| 核心优势 | 零门槛、多模型、轻量高效、隐私保护,兼顾新手与专业用户 | 自定义性强,适合专业开发者调试模型 | 轻量,适合单纯聊天使用 | 模型优化好,适合专业人士深度使用 |

总的来说,相比其他同类软件,Ollama 的核心优势在于全能性、易用性、免费性,既能一键搞定下载、安装、模型启动,又能多模型、可自定义、完全免费开源、无广告无捆绑,跨平台适配性强,是目前性价比最高、最实用的本地 AI 运行工具,也是新手入门本地 AI 的首选。

下载 Ollama

Ollama 安装包下载地址:https://pan.quark.cn/s/a632cb67243a

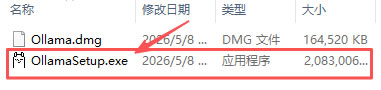

下载链接内分别提供了 Windows、mac 系统的安装包:

- Windows 系统下载:OllamaSetup.exe

- mac 系统下载:Ollama.dmg

Linux 系统下载命令(把命令粘贴到终端里):

curl -fsSL https://ollama.com/install.sh | sh

安装 Ollama

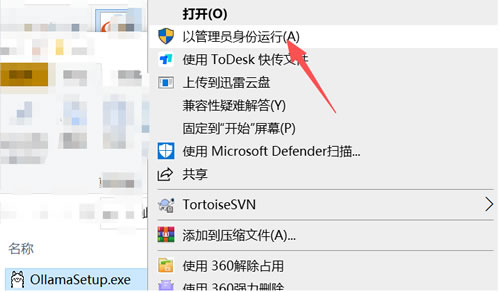

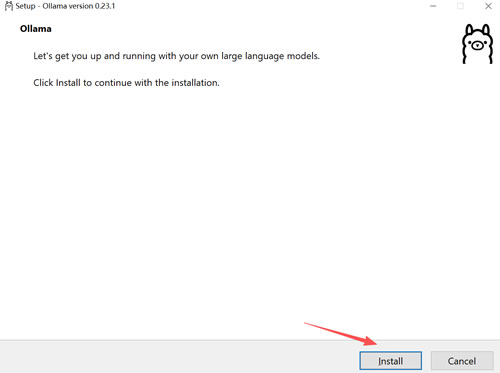

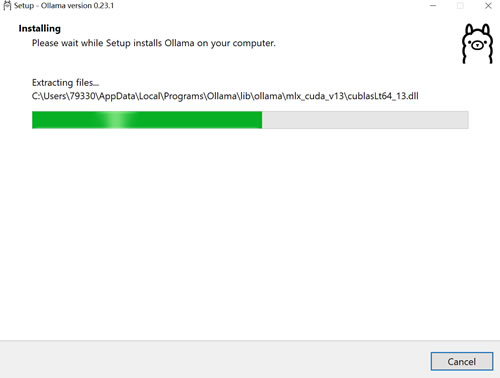

我的电脑是 Windows 系统,所以这里以安装 OllamaSetup.exe 为例:

1) 安装包下载后如下图内容所示:

2) 选择“ OllamaSetup.exe ”,右键—“以管理员身份运行”:

3) 点击“ Install ”:

4) 等待进度条加载到 100%:

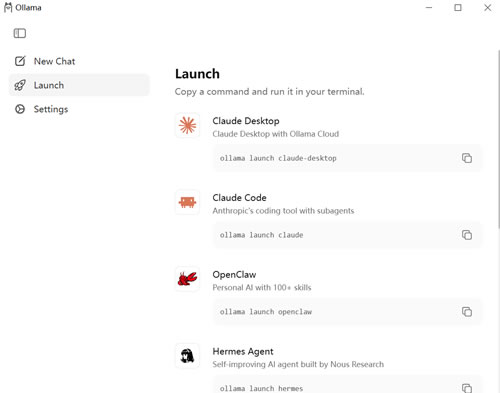

5) 出现主界面,安装完成:

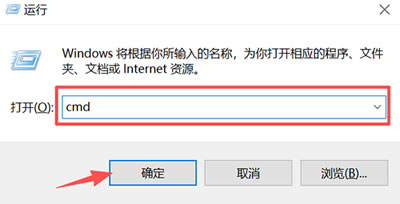

6) 点击底部任务栏的“搜索图标”,输入 cmd——按 enter——打开“运行”对话框:

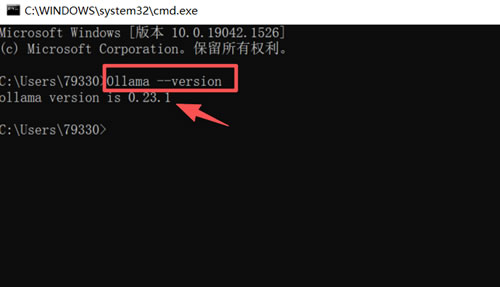

7) 输入命令“ ollama --version ”,若显示版本号,说明安装成功:

修改 Ollama 路径

修改 Ollama 安装路径:

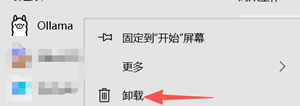

1) 把已装的 Ollama 卸载(开始菜单 → Ollama → 卸载):

2) 以管理员身份打开 PowerShell,cd 到你保存安装包的目录(比如 cd D:\Downloads):

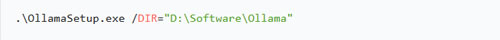

3) 执行:

4) 再重新安装 Ollama 安装包即可。

修改模型存储路径:

1) 在 D 盘新建文件夹,例如:" D:\ollamaModels ":

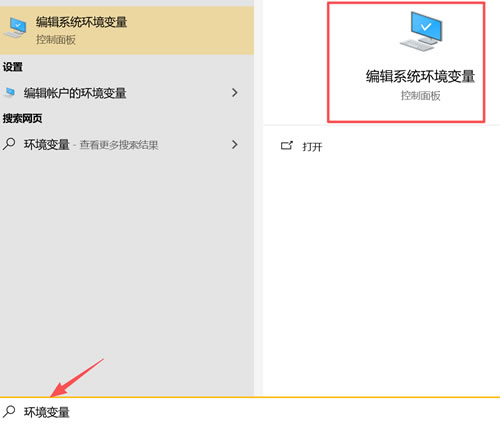

2) 按 Win+S 搜索 环境变量 → 打开 “编辑系统环境变量” → 点 “环境变量”:

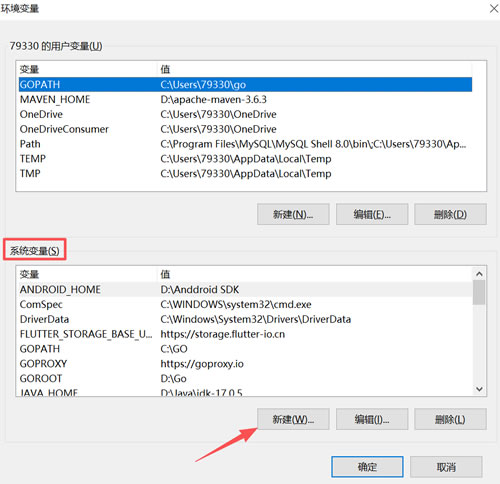

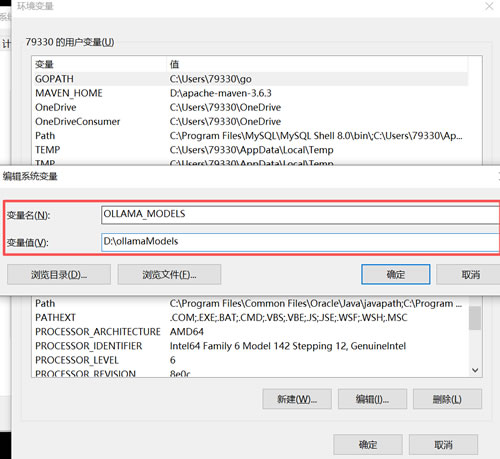

3) 在系统变量点 “新建”:

4) 把下面内容复制到方框内,点击“确定”:

- 变量名:OLLAMA_MODELS(必须全大写)

- 变量值:D:\ollamaModels(刚建的路径)

5) 重启电脑后模型存储路径修改完成。

Ollama使用注意事项和常见问题

使用注意事项

1) 下载模型时,应确保电脑有足够的存储空间,避免下载失败。轻量模型(3B)约 3GB 、主流模型(7B)约 4-6GB 、大型模型(30B+)约 24GB 以上。

2) 以管理员身份运行安装包( Windows 系统),否则会出现权限不足、安装失败、无法启动等问题。

3) 运行大型 AI 模型时,确保电脑配置达标,内存建议 16GB 及以上,GPU 推荐有 NVIDIA CUDA 支持,否则会出现卡顿、闪退等问题,低配电脑建议选择轻量模型。

4) 国内用户下载模型时,建议配置国内镜像加速,否则下载速度较慢,甚至下载失败。

5) 修改模型路径时,建议选择纯英文路径(如 D:\Ollama\Models ),否则会出现模型无法加载、软件闪退等问题。

6) Ollama 仅支持 Windows 、 Mac 、 Linux 系统,不支持手机端,不要在手机上下载安装,无法正常运行。

7) 不要随意修改软件安装目录下的文件,否则会导致软件无法正常运行,若出现问题,可重新安装软件解决。

常见问题和解决办法

1) Ollama 下载后,无法安装/启动?

- Windows用户:右键安装包,选择“以管理员身份运行”,重新安装;

- 检查电脑系统是否符合要求( Windows 10 +、 MacOS 12+ ),老旧系统需下载旧版本;

- 关闭杀毒软件,部分杀毒软件会误报,导致无法启动;

- 若仍无法启动,重新下载安装包。

2) 安装完成后,输入“ ollama --version ”不显示版本号?

- Windows用户:检查安装时是否勾选“ Add to PATH ”,若未勾选,重新安装并勾选;

- 手动添加环境变量,将 Ollama 安装目录添加到系统环境变量中;

- 重启命令提示符/终端,重新输入命令。

3) 下载模型时,速度极慢、下载失败?

- Windows 用户在 PowerShell 中输入“ $env:OLLAMA_MODEL_SERVER=" https://mirror.ollama.com ";

- Mac/Linux 用户在终端输入“ export OLLAMA_MODEL_SERVER=https://mirror.ollama.com ”;

- 检查网络连接,切换稳定网络;

- 暂停下载后重新开始,或更换轻量模型尝试。

4) 启动模型后,电脑卡顿、闪退?

- 关闭其他占用资源的软件,释放内存和 CPU;

- 更换轻量模型(如 3B、7B 模型),低配电脑不建议运行大型模型;

- 检查电脑温度,避免过热导致闪退;

- 升级 Ollama 到最新版本,修复已知 bug 。

5) Mac 系统启动 Ollama 后,提示“无法验证开发者”?

打开“系统设置”→“隐私与安全性”,找到 Ollama ,点击“允许来自此开发者的应用”,即可正常启动,这是 Mac 系统的安全验证,无需担心。

6) 无法修改模型保存路径,或修改后模型无法加载?

- 不要选择中文路径,修改为纯英文路径;

- Windows 用户通过环境变量设置“ OLLAMA_MODELS ”,重启 Ollama;

- Mac/Linux 用户在终端输入“ export OLLAMA_MODELS= 你的路径”,重启 Ollama 。

7) 启动 Ollama 服务时,提示“端口占用”?

- 检查是否有其他软件占用 11434 端口( Ollama 默认端口),关闭占用端口的软件;

- 手动修改 Ollama 端口,通过命令“ ollama serve --host 127.0.0.1:11435 ”(更换为其他端口)启动服务。

总结

Ollama 是目前 Windows、 Mac 、Linux 平台最适合普通人的本地 AI 运行工具,尤其适合新手小白,零门槛、免费、无广告,不用懂代码、不用配置环境,下载安装后一键就能使用,几分钟就能上手。对专业用户来说,它多模型支持、可自定义、跨平台适配,支持API兼容和模型微调,能满足开发、科研、评测等专业需求。相比同类软件,它兼顾易用性和专业性,一套工具搞定所有本地 AI 需求,不用来回切换软件,性价比拉满。 Ollama 的出现,标志着大模型技术真正走向了“平民化”。它让本地部署不再是技术大牛的专利,而是每个普通用户都能触达的能力。

ICP备案:

ICP备案: 公安联网备案:

公安联网备案: